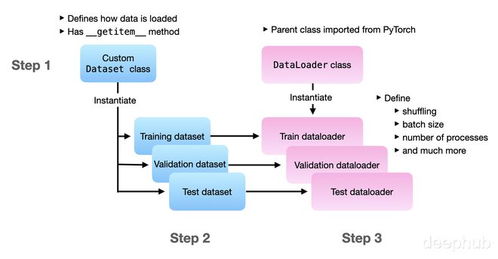

PyTorch數(shù)據(jù)處理 torch.utils.data模塊的7個核心函數(shù)詳解

在深度學(xué)習(xí)中,數(shù)據(jù)處理是模型訓(xùn)練和評估的關(guān)鍵環(huán)節(jié)。PyTorch作為一個流行的深度學(xué)習(xí)框架,提供了強(qiáng)大而靈活的數(shù)據(jù)處理工具,其中torch.utils.data模塊是核心。它允許我們高效地加載、預(yù)處理和批處理數(shù)據(jù),從而簡化了訓(xùn)練流程。本文將詳細(xì)介紹torch.utils.data模塊中最重要的7個核心函數(shù)及其用法,幫助您掌握PyTorch數(shù)據(jù)處理的精髓。

1. Dataset

Dataset是一個抽象類,是所有自定義數(shù)據(jù)集的基礎(chǔ)。它定義了如何獲取單個數(shù)據(jù)樣本及其標(biāo)簽。您需要繼承Dataset并實(shí)現(xiàn)兩個方法:

<strong>len</strong>(): 返回?cái)?shù)據(jù)集中的樣本總數(shù)。<strong>getitem</strong>(idx): 根據(jù)索引idx返回對應(yīng)的樣本(例如,圖像和標(biāo)簽)。

示例代碼:`python

from torch.utils.data import Dataset

class CustomDataset(Dataset):

def init(self, data, labels):

self.data = data

self.labels = labels

def len(self):

return len(self.data)

def getitem(self, idx):

return self.data[idx], self.labels[idx]`

2. DataLoader

DataLoader是數(shù)據(jù)加載的核心工具,它將Dataset包裝成一個可迭代對象,支持自動批處理、打亂數(shù)據(jù)和多進(jìn)程加載。主要參數(shù)包括:

dataset: 要加載的數(shù)據(jù)集對象。batch_size: 每個批次的大小。shuffle: 是否在每個epoch打亂數(shù)據(jù)。num_workers: 用于數(shù)據(jù)加載的子進(jìn)程數(shù)。

示例代碼:`python

from torch.utils.data import DataLoader

dataloader = DataLoader(dataset, batchsize=32, shuffle=True, numworkers=4)

for batchdata, batchlabels in dataloader:

# 訓(xùn)練代碼

`

3. random_split

random_split用于將數(shù)據(jù)集隨機(jī)分割為多個子集,常用于劃分訓(xùn)練集、驗(yàn)證集和測試集。它接受一個數(shù)據(jù)集和子集長度的列表,返回多個Subset對象。

示例代碼:`python

from torch.utils.data import random_split

trainsize = int(0.8 * len(dataset))

valsize = len(dataset) - trainsize

traindataset, valdataset = randomsplit(dataset, [trainsize, valsize])`

4. Subset

Subset用于創(chuàng)建數(shù)據(jù)集的子集,通常與random_split結(jié)合使用。它接受一個數(shù)據(jù)集和索引列表,返回包含指定索引樣本的子集。

示例代碼:`python

from torch.utils.data import Subset

indices = [0, 2, 4] # 選擇索引為0, 2, 4的樣本

subset = Subset(dataset, indices)`

5. ConcatDataset

ConcatDataset用于合并多個數(shù)據(jù)集,創(chuàng)建一個更大的數(shù)據(jù)集。這在處理來自不同來源的數(shù)據(jù)時非常有用。

示例代碼:`python

from torch.utils.data import ConcatDataset

combined_dataset = ConcatDataset([dataset1, dataset2])`

6. WeightedRandomSampler

WeightedRandomSampler是一個采樣器,允許根據(jù)權(quán)重隨機(jī)采樣數(shù)據(jù)。這對于處理類別不平衡的數(shù)據(jù)集特別有用,可以為少數(shù)類樣本分配更高的權(quán)重。

示例代碼:`python

from torch.utils.data import WeightedRandomSampler

weights = [0.1, 0.9] # 假設(shè)兩個類別的權(quán)重

sampler = WeightedRandomSampler(weights, numsamples=100, replacement=True)

dataloader = DataLoader(dataset, batchsize=32, sampler=sampler)`

7. default_collate

default<em>collate是一個函數(shù),用于將多個樣本組合成一個批次。DataLoader默認(rèn)使用它來處理批處理。如果您有特殊的數(shù)據(jù)結(jié)構(gòu)(如變長序列),可以自定義collate</em>fn來覆蓋默認(rèn)行為。

示例代碼:`python

from torch.utils.data.dataloader import default_collate

def custom_collate(batch):

# 自定義批處理邏輯

return default_collate(batch)

dataloader = DataLoader(dataset, batchsize=32, collatefn=custom_collate)`

###

通過掌握這7個核心函數(shù),您可以高效地處理各種數(shù)據(jù)場景,從簡單的數(shù)據(jù)集加載到復(fù)雜的批處理和采樣策略。torch.utils.data模塊的設(shè)計(jì)強(qiáng)調(diào)靈活性和可擴(kuò)展性,使得PyTorch在數(shù)據(jù)處理方面表現(xiàn)出色。建議在實(shí)際項(xiàng)目中多練習(xí)這些函數(shù),結(jié)合具體需求進(jìn)行定制化,以提升深度學(xué)習(xí)工作流的效率。

無論是構(gòu)建自定義數(shù)據(jù)集、劃分訓(xùn)練驗(yàn)證集,還是處理不平衡數(shù)據(jù),這些工具都能為您提供強(qiáng)大的支持。隨著PyTorch版本的更新,該模塊可能會引入更多功能,因此建議關(guān)注官方文檔以獲取最新信息。

如若轉(zhuǎn)載,請注明出處:http://m.qixin123.cn/product/68.html

更新時間:2026-04-08 15:40:59